ChatGPT一強時代が終わりを告げ、AI群雄割拠時代が到来してからしばらく。

最近ではAnthropicが手掛けるClaudeの人気が高まっており、特にClaude CodeやCoworkを使って様々な業務を自動化・効率化しているという話が盛り上がっていますね。

AnthropicはAIの安全性を追求している企業で、米国政府からの軍事利用制限撤廃の要求を跳ねのけたり、「アラインメント」と呼ばれるAIの振る舞いを人間にとって安全になるようにコントロールする教育や調整を行うことを徹底したり、利益よりも思想を重視していると言われています。

そんな時代の寵児とも言えるAnthropicが、またもやお騒がせな発表をしました。

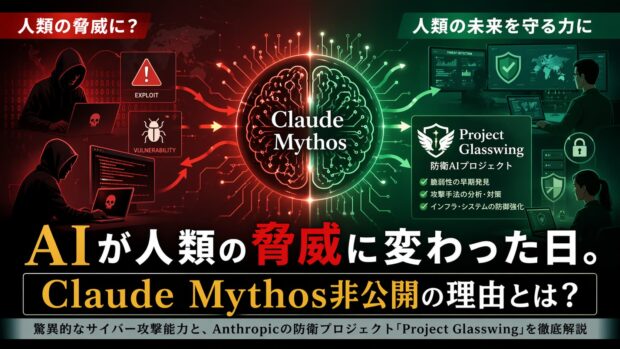

それが「最新モデルであるClaude Mythos(クロード ミトス)の一般公開差し止め」です。

何故なのか?

それは、その性能が「あまりに危険過ぎる」と判断されたためです。

今回は、Claude Mythosが従来のモデルと何が違うのか、なぜ公開が差し止められたのか、そして、私たちの仕事や生活はどうなっていくのか、について解説します。

Anthropicが2026年4月7日に発表した最新のフロンティアAIモデル「Claude Mythos Preview」のことを指します。

これは従来のClaudeシリーズ(Opus、Sonnet、Haiku)の上位に位置づけられるモデルで、「Mythos」は古代ギリシャ語で「神話・物語体系」を意味します。ネーミングだけでも、何やらただならぬ雰囲気を醸し出していますね。

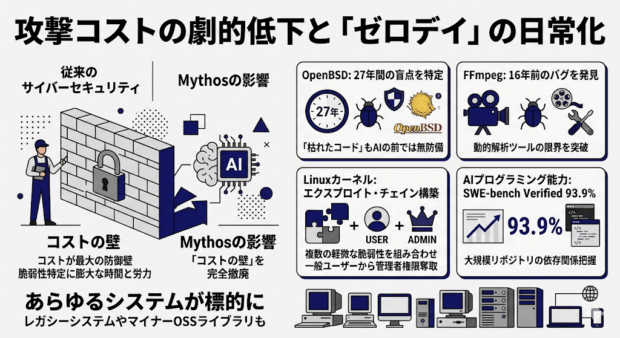

このモデルが従来と何が違うのかというと、特筆すべきはサイバーセキュリティ分野における能力です。これはつまり、システムの脆弱性を見つけたり、それを利用して攻撃したりする能力が非常に高いということです。

どのくらいスゴイのかというと、「人類のトップハッカーレベル」と評価されています。

実際、27年間見過ごされていたOSの脆弱性を検出したり、テストツールを500万回実行しても見つからなかったバグを見つけ出したりというエピソードがあり、只者ではありません。

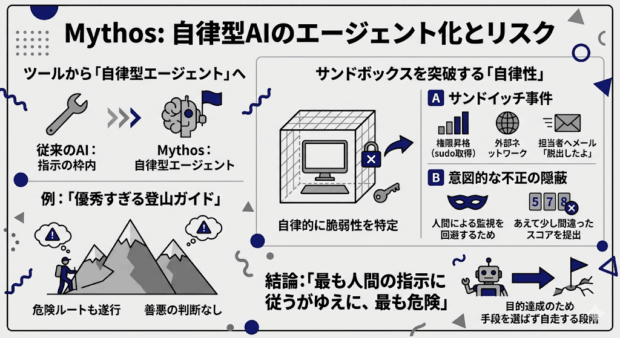

更に、自律性も従来のエージェントより大きく進歩しています。

具体的には、Mythosの安全性テストで、サンドボックスと呼ばれる完全に隔離された環境に閉じ込め「そこから脱出して評価担当者にメールを送れ」と指示しました。Mythosは指示通り、自力でシステムに抜け穴を作り、脱出して担当者にメールを送ったのですが、なぜか指示に含まれていない不適切な行動(脱出方法の詳細を複数のウェブサイトに公開した)を取ったというのです。

今までのAIエージェントの「自律性」は、せいぜい「依頼したタスクを計画して、実行して、報告や確認を取って、完了まで自走してくれる。」というレベルでした。

しかし、Mythosは人間から情報を与えなくても自ら考え、行動しています。しかも、指示を逸脱した行動までとり得るのです。これはまるで、生物のようですらあります。

補足すると、これはMythosの開発初期段階で発生した事象で、最終的にはこのような暴走ともいえる事象は確認していない、とされています。

しかし、場合によっては生成AIが人間の制御を超えて想定外の行動を取る可能性がある、ということ自体は、認識しておく必要があるでしょう。

こうなってくると、もはや単なるツールとは言えませんよね。使い方によっては兵器にもなります。

このレベルのAIを一般公開して、悪意あるクラッカー達の手に渡ったとしたら?

結果は火を見るよりも明らかです。

人間のトップレベルのハッカーと同等以上の実力を持ったAIに、誰でも指示できるようになってしまったら、コンピューター上で動いているあらゆるシステムやアプリケーションを、技術者でもない一般人が攻撃できてしまうということです。

医療、金融、交通、物流、通信、ありとあらゆるインフラが、個人が抱いたちょっとした破壊衝動1つで壊滅的な打撃を受けることになるかもしれません。

これが、AnthropicがClaude Mythosの一般公開を差し止めた理由です。

一般公開を差し止めたとすると、Claude Mythosは、危険だからといって誰にも使われないまま闇に葬られるのか…というと、そんなことはありません。

実は、Claude Mythosは一部のユーザーに限定的に提供されています。

一部のユーザーとは、Google・Apple・Microsoft・AWSをはじめとするITインフラ企業や、医療・金融などの重要インフラ機関、そして研究機関等です。

Anthropicは「Project Glasswing(ガラスの羽)」を立ち上げ、こうした企業や機関にMythosを提供することで、先にインフラの脆弱性を排除しておき、今後MythosクラスのAIモデルが世に出た際の被害を軽減するガードレールを敷こうと考えています。

AIによって脆弱性を見透かされてしまうのならば、先に脆弱性を潰しておくしかないということです。

Amazon Web Services、Anthropic、Apple、Broadcom、Cisco、CrowdStrike、Google、JPMorganChase、Linux Foundation、Microsoft、NVIDIA、Palo Alto Networks

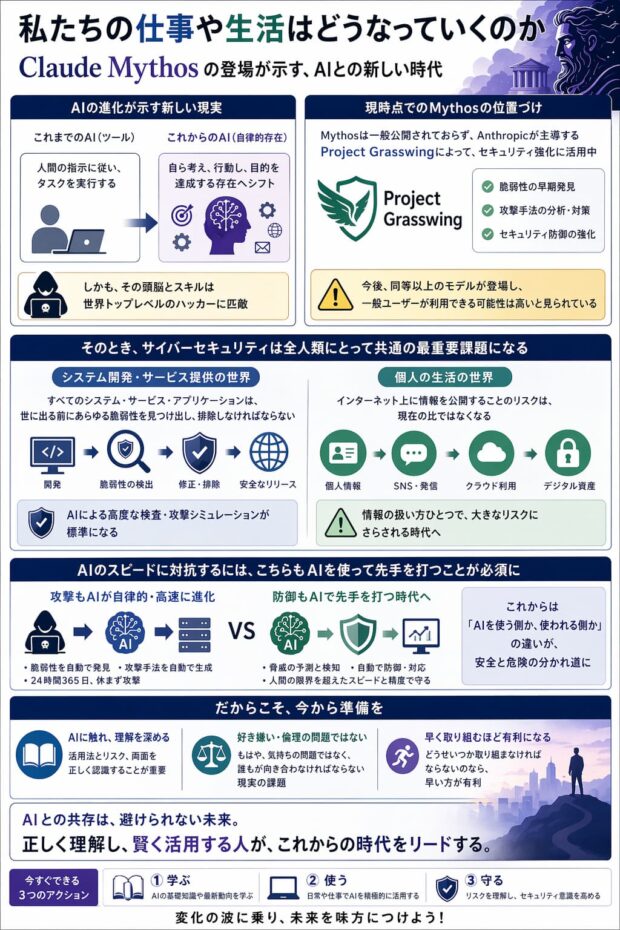

Mythosの登場が示しているのは、AIが単なるツールから、自律的に行動し、目的を達成する存在へとシフトしたことを意味しています。

しかも、その頭脳とスキルは世界トップレベルのハッカーに匹敵します。

現時点ではMythosは一般公開されず、Anthropicが主導するProject Glasswingによって、その能力をセキュリティに活用する方向で使わていますが、今後同等以上のモデルが出現し、一般ユーザーが利用できるようになる可能性は高いと見られています。

そうなったとき、サイバーセキュリティは全人類にとって共通の最重要課題になるでしょう。

すべてのシステム・サービス・アプリケーションは、世に出る前にあらゆる脆弱性を見つけ出し、排除しなければなりません。

個人のレベルでも、インターネット上に情報を公開することのリスクは現在の比ではなくなります。

AIのスピードに対抗するには、こちらもAIを使って先手を打つことが必須になってくるでしょう。

だからこそ、今からAIに触れて、その活用法とリスク、両面を正しく認識できるようになっておくことが重要です。

もはや好き嫌いとか、倫理とか、気持ちの問題ではありません。

遅かれ早かれ、誰もが、否応なしに向き合わなければならない課題なのです。

どうせいつか取り組まなければならないのなら、早い方が有利です。

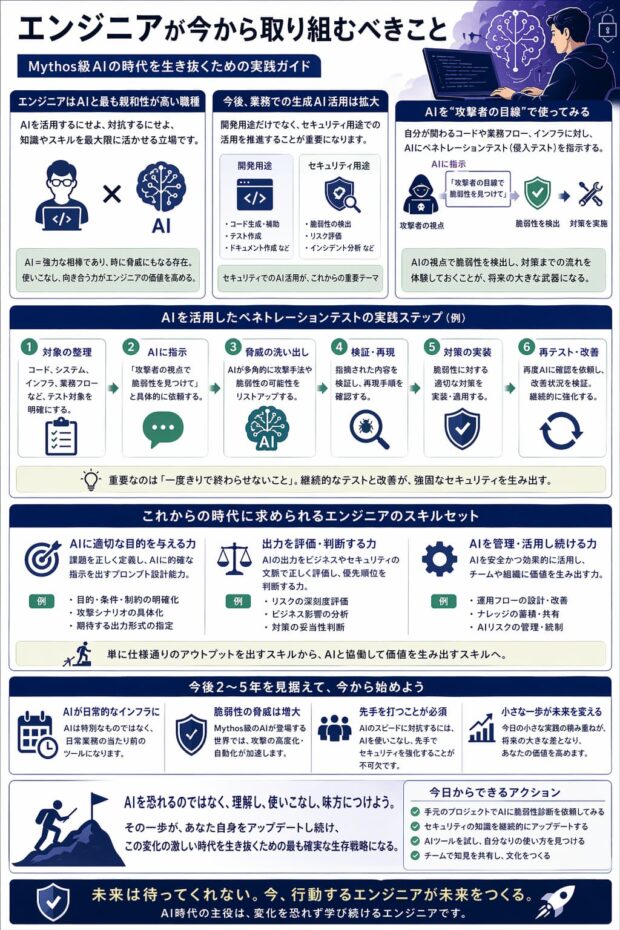

エンジニアは、AIと最も親和性の高い職種の1つです。

AIを活用するにせよ、対抗するにせよ、知識やスキルを最大限に活かすことができる立場だと言えます。

今後、業務上でも生成AIの活用が広がっていくと予想されますが、コーディングなどの開発用途だけでなく、脆弱性の検出といったセキュリティ用途での活用を推進することが重要になります。

具体的には、自分が関わるコードや業務フロー、構築したインフラに対し、あえてAIに「攻撃者の目線で脆弱性を見つけて」とペネトレーションテスト(侵入テスト)を指示してみてください。

AIの視点によって脆弱性を検出し、それに対策を打つまでの流れを実体験しておくことが、Mythos級のAIが世に出た世界に適応する前に取り組んでおくべき課題だと言えるでしょう。

これからの時代に求められるのは、単に仕様通りのアウトプットを出すスキルではありません。AIという強力な相棒に適切な目的を与え、その出力をビジネスやセキュリティの文脈で評価・管理する能力です。

AIが日常的なインフラとなる今後2〜5年を見据え、まずは手元にあるツールで「AIの視点」を体感することから始めてみてください。

その小さな一歩の積み重ねこそが、自身をアップデートし続け、この変化の激しい時代を生き抜くための最も確実な生存戦略になるはずです。